KI in den Medien: Proaktiv nutzen statt verbieten!

Anstatt KI-generierte Medieninhalte aus Angst vor Desinformation und Propaganda zu verbieten, sollten prodemokratische Kräfte die neuen Technologien für ihre Kommunikationsarbeit aktiv nutzen, meint der Medienwissenschaftler und Digitalethiker Jan Doria.

Im Eingangsbereich des „Hotel Silber“ in Stuttgart – in der Nazizeit Gestapo-Hauptquartier, in dem unter anderem Eugen Bolz und Hans Scholl inhaftiert waren, heute Erinnerungsort und Museum – finden sich, einander gegenübergestellt, zwei eigentümliche Aufnahmen der Stuttgarter Innenstadt aus dieser Zeit: das linke Original zeigt den mit einer Hakenkreuzfahne geschmückten Charlottenplatz. Die rechts abgebildete Kopie hingegen entstand erst nach Kriegsende, als man die Hakenkreuzfahne wegretuschierte, aus Scham, und um vergessen zu machen, was man unbedingt vergessen wollte.

KI als Steigerungsproblem

Das historische Beispiel zeigt: Die Manipulation von Medien zum Zwecke der absichtsvollen Täuschung ist kein neues Phänomen. Desinformation gibt es, seit es Medien gibt: Von der antiken damnatio memoriae, als die Namen in Ungnade gefallener Herrscher aus steinernen Inschriften getilgt wurden, über die Flugblätter der Reformationszeit, in denen sich Katholiken und Protestanten mit furchterregenden Holzschnitten gegenseitig des Teufels bezichtigten, bis hin zu Uncle Sam, der im Ersten Weltkrieg mit „I Want You For US Army“ für den Eintritt in der US-Armee warb. Medieninhalte, egal ob Text, Bild, Ton oder Video, werden dazu genutzt, um Menschen von einer Sache zu überzeugen, emotional anzusprechen, Ideologien zu verbreiten und die Wirklichkeit so darzustellen, wie sie der jeweilige Autor sich wünscht – mit der Werbebranche lebt eine ganze Industrie ausschließlich hiervon.

Durch die Methoden der generativen Künstlichen Intelligenz (KI) entstehen nun neue Möglichkeiten, manipulative und manipulierte Medieninhalte herzustellen: Da trägt der Papst plötzlich eine unangemessen teure Daunenjacke, und der US-Präsident ernennt sich nach dessen Ableben gleich selbst zu seinem Nachfolger. Mit dem Begriff der Steigerung des Jenaer Soziologen Hartmut Rosa lässt sich das Phänomen der KI-generierten Deep Fakes als das begreifen, was es eigentlich ist: Keine qualitative Veränderung des Desinformationsproblems – denn Manipulation gab es schon immer –, sondern eben eine quantitative Steigerung. Denn Künstliche Intelligenz selbst ist nicht die Ursache für Desinformation, sie potenziert lediglich die Möglichkeiten zu ihrer Herstellung und Verbreitung.

Das Zensurdilemma

In der Folge werden Rufe laut, den Einsatz von KI in der Medienwelt strengst möglich zu regulieren oder gleich ganz zu verbieten. So sieht beispielsweise die europäische KI-Verordnung in Art. 50 eine Kennzeichnungspflicht für KI-generierte Medieninhalte vor, wie sie auch der Deutsche Journalistenverband fordert. Dabei fällt jedoch eines unter den Tisch: Wer immer eine solche Kennzeichnung fordert, muss im selben Atemzug auch benennen, wer diese durchsetzen und kontrollieren soll. Für die Regulierung von Medieninhalten sind in Deutschland aus gutem historischem Grund staatsferne und unabhängige Stellen zuständig wie der Deutsche Presserat für die Printverleger, die Rundfunkräte für die Landesrundfunkanstalten der Öffentlich-Rechtlichen und die Landesmedienanstalten für die privaten Radio- und Fernsehsender. Jede Regulierung von Medieninhalten birgt schließlich die Gefahr, einen zu tiefen Eingriff in das Grundrecht auf Meinungs- und Pressefreiheit (Art. 5 GG) darzustellen: Denn wer bestimmt, ab wann ein Medieninhalt „manipulativ“ ist, und welche Behörde soll entscheiden, ob die Lokalzeitung ihrer Pflicht zur Kennzeichnung des KI-generierten Berichts von der Stadtratssitzung ordnungsgemäß nachgekommen ist – am Ende gar der Oberbürgermeister selbst? Die Entscheidung des Bundesgesetzgebers, die Aufsicht über die KI-Verordnung der Bundesnetzagentur, einer weisungsgebundenen Behörde im Geschäftsbereich des Bundeswirtschaftsministeriums, zu übertragen, gewinnt vor diesem Hintergrund zumindest ein „Geschmäckle“, wie man in Baden-Württemberg sagt.

Habermas ist tot – es lebe die KI

Das Zensurdilemma zeigt: Es gibt kein Zurück mehr zu einer Medienlandschaft ohne KI – und gleichzeitig verändern sich durch KI die Grundstrukturen des Mediensystems selbst. An die Stelle des deliberativen Meinungsbildungsprozesses, des „zwanglosen Zwangs des besseren Arguments“, treten in der Welt von TikTok, Instagram und X Schnelligkeit, Emotion und die direkte Ansprache des zumeist jungen Zielpublikums. Jürgen Habermas ist tot, und seine Wiederauferstehung als KI-generiertes Hologramm lässt auf sich warten.

Anstatt Künstliche Intelligenz anstandslos zu verteufeln, sollten prodemokratische Kräfte diese jüngste Medienrevolution daher in ähnlicher Weise für sich nutzen, wie Martin Luther es vor 500 Jahren tat, als das neue Medium Buchdruck die Welt eroberte: Als wirkmächtiges Werkzeug, um Menschen direkt zu erreichen und wieder neu für den Wert der Demokratie zu gewinnen. Zwei Beispiele hierfür seien zum Schluss genannt.

landtagswahl.ai

Das Institut für Demokratie und Künstliche Intelligenz (IDEMKI) in Tübingen nutzte im Frühjahr 2026 in Kooperation mit der Landeszentrale für politische Bildung Baden-Württemberg (lpb) und dem Volkshochschulverband Baden-Württemberg ChatGPT, um wirkmächtige Illustrationen der Landtagswahlprogramme aller sechs aussichtsreichen Parteien zu generieren – denn ein mehrere hundert Seiten langes Wahlprogramm wird nicht gelesen, ein Bild dagegen angeschaut.

Freilich können die Bilder von landtagswahl.ai die eigenständige inhaltliche Auseinandersetzung mit den politischen Forderungen der jeweiligen Parteien nicht ersetzen – sie können jedoch zu einer vertieften Diskussion anregen, auch und gerade darüber, was in welchem Bild wie warum dargestellt worden ist und wie sich diese Darstellung mit der eigenen Vorstellung vom Programm der jeweiligen Partei deckt.

Die Klage der Biene

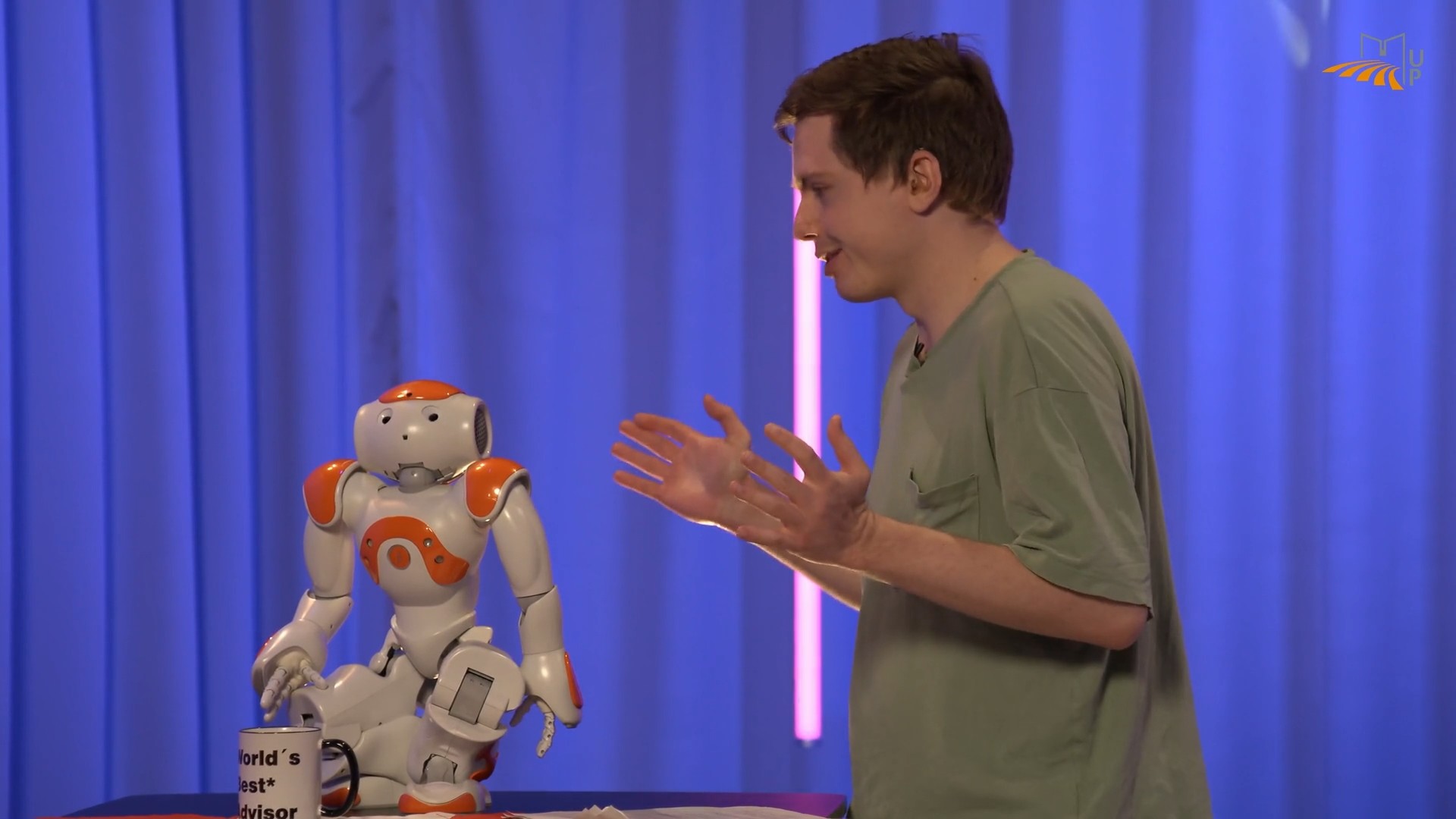

Der Autor dieses Beitrags selbst nutzte im Mai 2025 auf einem Science Slam der Universität Passau und der Deutschen Akademie der Technikwissenschaften das Voice-Cloning-Tool „Elevenlabs“, um einen kleinen Roboter zum Leben zu erwecken und auf eine fiktive Reise nach Peru zu entführen, wo er die negativen Umweltauswirkungen von KI-Technologien kennenlernte.

Der Text des Dialoges beruht vollständig auf menschlicher Kreativität, die dort erwähnten Fakten sind alle wahr (einschließlich der Klimaklage des Andenbauern Saul Luciano Lliuya, welche dieser allerdings gegen RWE und nicht gegen ein fiktives KI-Start-Up führte). Lediglich die Stimme des Roboters gehört keinem Menschen, sondern einer KI – aber wie sollte es auch anders sein? So entsteht ein co-kreativer Prozess zwischen Mensch und Maschine, eine künstlerische Zusammenarbeit, bei der die beiden Partner nicht im Wettbewerb zueinander stehen, sondern sich gegenseitig ergänzen.

Die Herausforderung KI in der politischen Kommunikation ist damit angenommen: Nicht als drohende Gefahr, die unserer Demokratie den Todesstoß verleiht. Sondern als Chance, sie für eine bessere prodemokratische Kommunikation zu nutzen.

Kontakt

Wollen Sie mit uns in Kontakt treten?

Weitere Information zu uns und wie Sie Ihren Beitrag bei FMP veröffentlichen können, finden Sie hier.